近年生成式AI大行其道,不少人紛紛將照片轉換成不同風格的卡通圖像,一秒變身動畫角色或電影主角。透過AI技術,幾十秒內就能生成逼真又有趣的照片。然而,你又有否細閱過這些應用程式的私隱條款?

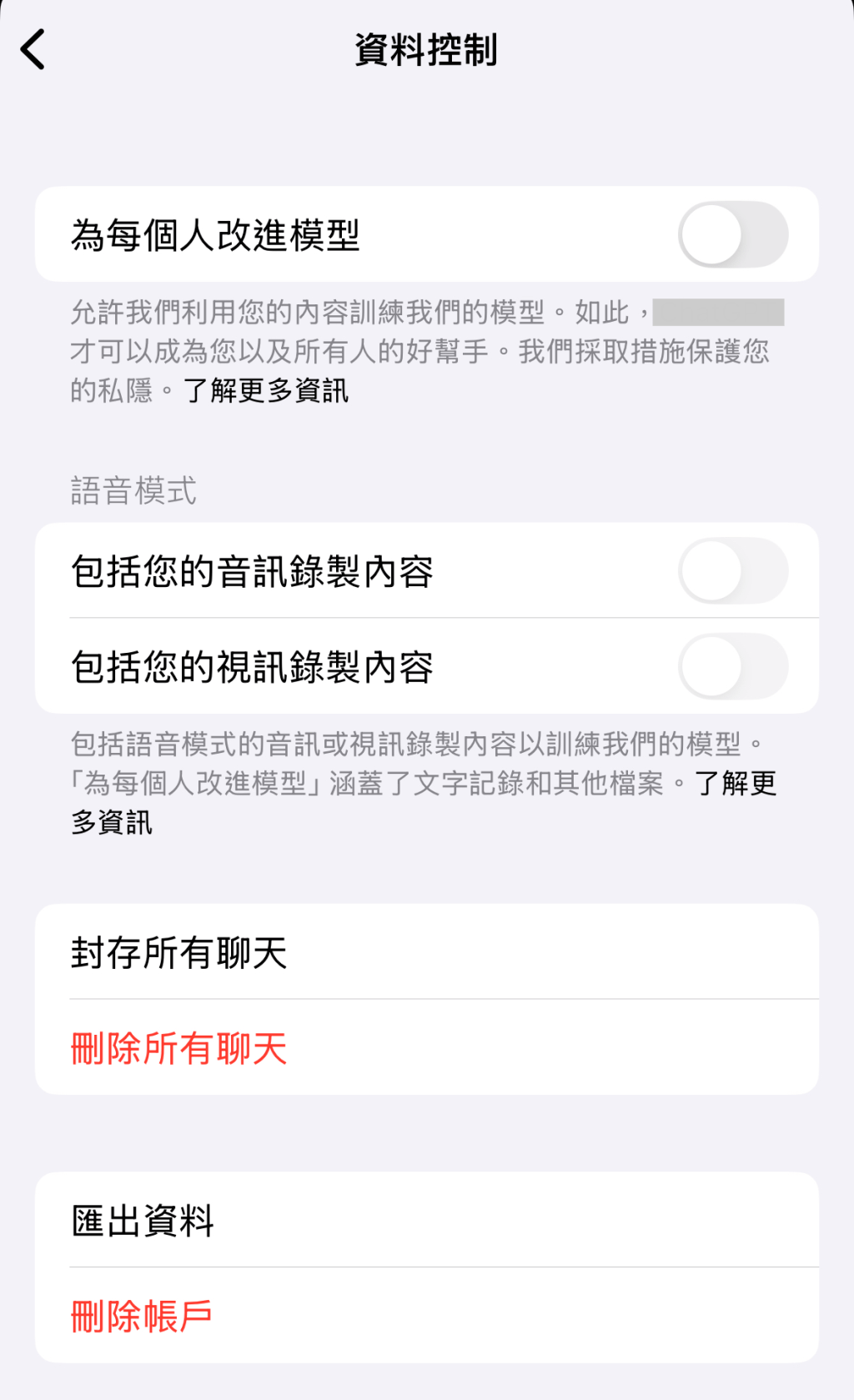

opt-out選項多藏頁面深處

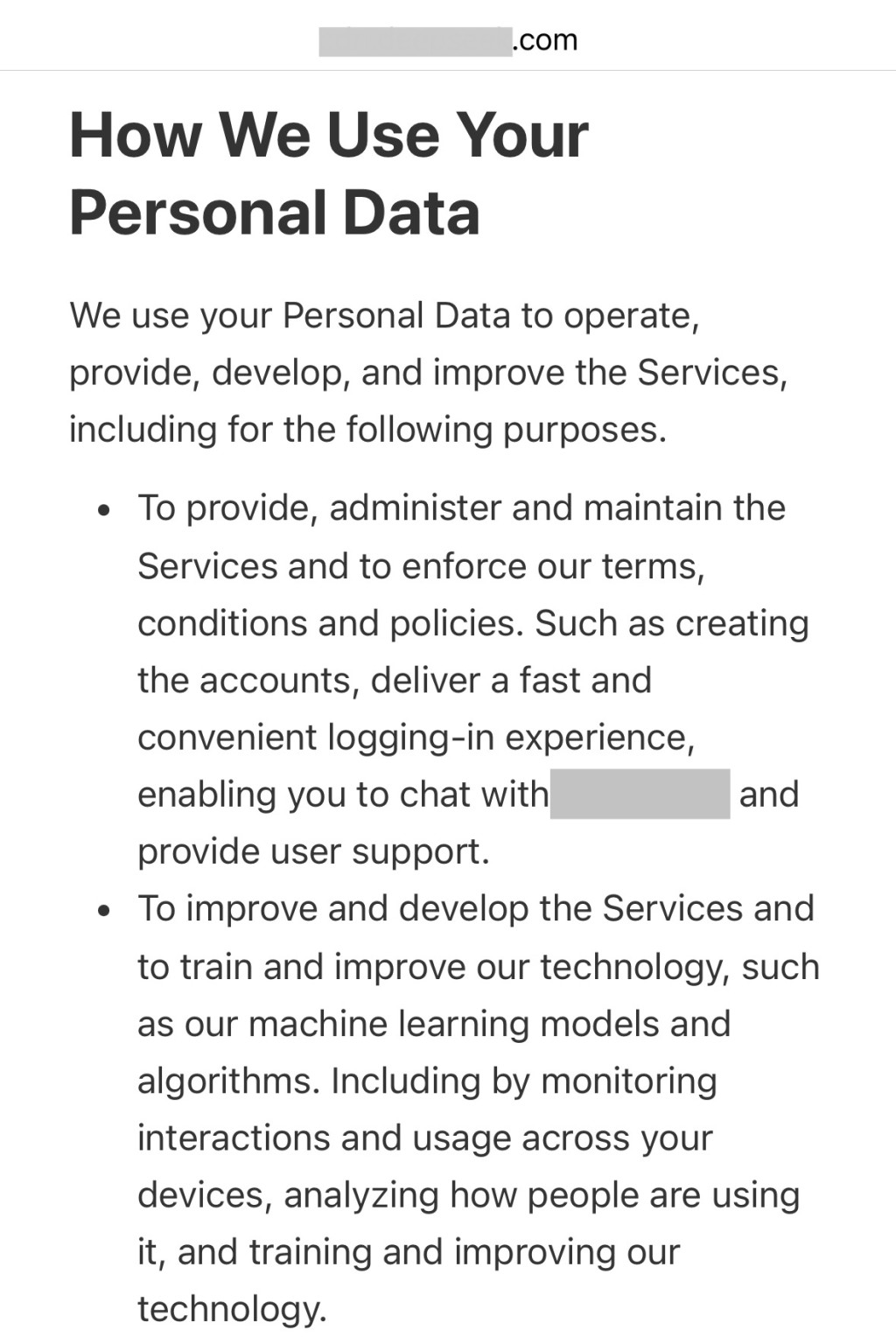

事實上,部份AI應用程式並不保證不會將用戶上載的內容(如相片、文字)用作訓練AI模型之用。有些App雖提供「退出(opt-out)」選項讓用戶拒絕參與訓練,但通常藏身於設定頁面深處,甚至根本沒有這個選項。換句話說,使用沒有安全保障的AI應用程式生成圖片或詢問問題時,你所上傳的內容,可能在不知情下被納入訓練數據之中。如果不希望自己的數據被用作訓練AI模型,可以嘗試從設定頁面查看是否有相關設定,或仔細閱讀服務條款。

這種私隱風險,其實早在AI普及前已存在於不少手機應用程式及網上服務中。只是生成式AI的互動性更高,用戶往往為了獲得回應或出於對AI回答的好奇心,而忽略了背後的條款細節。

需要澄清的是,「成為訓練數據」並不等於AI會直接將你的原始內容直接展示給其他用戶,而是將其納入龐大的數據集中(註:大型語言模型通常以數十億甚至過千億個參數作訓練)。AI模型會從中學習數據的特徵,例如圖片組成部分,或文字邏輯順序和語氣,從而優化未來的回應,提升整體效能。

或間接構成數據洩露風險

若這些訓練資料中包含敏感資料或企業機密,便可能構成間接的數據洩露風險,對企業而言尤其重要。以Microsoft 365 Copilot為例,系統採用嚴格的「企業數據保護(Enterprise Data Protection)」政策,承諾不會將用戶數據用作模型訓練,亦透過加密技術保障數據傳輸安全,並支援稽核功能和Microsoft 365原生的安全控制選項,如敏感度標籤,讓企業在使用AI時更加安心,同時符合不同的私隱及合規要求。

此外,Microsoft 365 Copilot通過多項國際認證,包括ISO 27001、SOC2 Type 1、GDPR等,進一步保障系統整體的安全性、合規性及數據透明度。

除了技術層面保障,「負責任AI (Responsible AI)的概念亦日益受到重視。Microsoft的Responsible AI框架建基於六大原則:

1. 公平性(Fairness)

2. 可靠性和安全(Reliability & Safety)

3. 隱私權和安全性(Privacy & Security)

4. 包容性(Inclusiveness)

5. 透明度(Transparency)

6. 問責性(Accountability)

在模型訓練及回應用戶時,這些原則可確保AI回應以人為本、公平中立,避免偏見、歧視或不實回應,並為用戶提供完善的治理機制。同時,亦發表《負責任AI透明度報告》,展示其在開發與部署AI技術時,如何透過不同技術和決策實踐負責任與道德的原則。

應主動了解AI應用服務條款

作為使用者,我們應主動了解AI應用的服務條款及其對資料的使用方式。例如,許多人會上傳個人履歷(CV),希望AI協助潤飾或翻譯,卻忽略了當中潛在風險。你有否想過,若該應用程式的條款含糊不清,或未有提供清晰「退出」選項,這份包含姓名、聯絡方式、學歷等個人資料的完整文件,可能會納入某個語言模型的訓練資料之中?

這正是「負責任AI」強調「隱私權和安全性」及「透明度」的重要性,平台應清楚告知數據用途,讓用戶作出知情選擇。因此,使用AI服務時,我們應優先選擇信譽良好的平台,留意「數據是否用於模型訓練」等條款,並善用「退出」選項。最後,用戶的警覺和選擇,正是推動科技公司實踐「負責任AI的關鍵力量,亦是共同塑造更安全、更值得信賴AI生態系統的重要一環。

Nora Tam

微軟雲端策略架構師

註:如有任何疑問,歡迎發送WhatsApp傳送訊息至4626 2203